Wie Smart Speaker durchs Fenster gehackt werden können

Forscher haben eine neue Smart-Speaker-Schwachstelle offengelegt: Mit einem Laser können intelligente Lautsprecher sogar aus der Ferne gehackt werden. Abhilfe schafft laut Experten nur ein Redesign der Mikrofone.

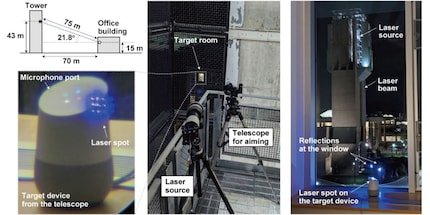

Du denkst, in den eigenen vier Wänden sei dein Smart Speaker vor Fremdzugriffen geschützt? Tja, da muss ich dich leider enttäuschen: Forscher aus Tokyo und Michigan haben eine wissenschaftliche Arbeit präsentiert, laut welcher es ihnen gelungen ist, Smart Speaker mit Laserpointern zu hacken. Mithilfe einiger zusätzlicher, handelsüblicher Gadgets – einem Laserdiodentreiber und einem Audio-Amplifier – konnten die Forscher fremde Lautsprecher nach dem Wetter fragen, Waren im Internet bestellen sowie Garagentore, Türen und Autos öffnen.

Unscheinbar und aus der Ferne

Nebst den bekannten Smart Speakern von Alexa und Google verschafften sich die Experten auch Zugriff zu einem iPhone XR, einem iPad der 6. Generation, einem Samsung Galaxy S9, einem Amazon Fire Cube TV und einem Google Pixel 2. Da stimmgesteuerte Systeme oft ohne Authentifizierung des Users arbeiten, gelang das Experiment, ohne Passwort oder PIN-Code zu knacken. Auch bei geschützten Systemen reichte eine Brute-Force-Attacke aus, da keine numerische Limitierung bei der Passwort- oder PIN-Eingabe bestand.

Der Strahl eines handelsüblichen Laserpointers schaffte es, die Systeme zu überlisten. Ein PC, ein Laserdiodentreiber, ein Audio-Amplifier und ein paar Kabel genügten, um fremde Türen und Schlösser problemlos öffnen zu können. Den Forschern gelang es, aus einer Entfernung von bis zu 110 Metern Zugriff auf fremde Smart Speaker zu erhalten und ihnen mit Laserstrahlen Befehle zu geben. Eine Voraussetzung dafür ist natürlich, dass sich der zu hackende Device im Sichtfeld des Übeltäters befindet.

Eine weitere Einschränkung bei diesem Hack besteht darin, dass der Laser punktgenau auf einen speziellen Teil des Mikrofons gerichtet werden muss, um Zugriff zu erhalten. Mit etwas Übung kriegt das allerdings auch ein Gelegenheitsdieb hin. Zudem kann der Laserstrahl beziehungsweise dessen Reflexion von anderen Personen – insbesondere, wenn der Angriff im Dunkeln stattfindet – wahrgenommen werden. Ausser, der Hacker benutzt einen Infrarot-Laser. Schliesslich werden eingegebene Befehle meist mit einer Sprachantwort des Smart Speakers bestätigt, was Personen in der Nähe ebenfalls alarmieren würde.

Das Diaphragma macht’s möglich

Die Laserattacken nutzen eine Schwachstellen in den Mikrofonen der Smart Speaker aus. Dabei sind all jene Mikrofone anfällig, die auf einem mikroelektromechanischen System (MEMS) basieren. Die mikroskopisch kleinen Komponenten dieser Mikrofone antworten auf Licht, als wären es Tonwellen. Obwohl die Forscher nur Siri, Alexa, Google Assistant, Facebook Portal und einige Handys getestet haben, befürchten sie, dass alle Geräte, die MEMS-Mikrofone nutzen, gefährdet sind.

Da solche Mikrofone sowohl Töne als auch Licht in elektrische Signale umwandeln, können Laser direkte Befehle an die Smart Speaker weitergeben. Wenn ein Hacker mithilfe einiger Gadgets also ein elektrisches Signal in eine bestimmte Intensität eines Laserstrahls umwandelt, kann er damit das Mikrofon täuschen und ihm einen Sprachbefehl vorgaukeln. Wie ist das möglich? Ein kleines Plättchen im Mikrofon – auch Diaphragma genannt – beginnt, sich beim Auftreffen von Tönen zu bewegen und gibt die Befehle in Form von elektrischen Wellen an die Schaltzentrale des intelligenten Lautsprechers weiter. Laserstrahlen können diese Bewegung imitieren und das Diaphragma so täuschen.

Quo vadis, MEMS-Mikrofon?

Obwohl einige Einschränkungen bestehen und weitere Gerätschaften nötig sind, sind die Erkenntnisse dieser Studie höchst alarmierend. Nicht nur zeigt die Studie eine weitere Schwachstelle von Smart Speakern und stimmgesteuerten Geräten im Allgemeinen, sondern auch, dass diese Attacken in realistischen Alltagssituationen möglich sind. Gefährlich ist zudem die Tatsache, dass die Forscher noch nicht alle Prozesse hinter dem Hack komplett nachvollziehen können. Last but not least zeigen die Resultate, dass Passwort- und PIN-geschützte Devices notwendiger sind denn je.

Was muss nun passieren, um MEMS-Mikrofone vor solchen Laserangriffen zu schützen? Ein einfaches Klebeband über die Mikrofone als Quick Fix reicht nicht aus, da stärkere Lichtquellen das Klebeband durchdringen. Einige Forscher aus Japan und den USA sprechen von einem kompletten Redesign der Mikrofone. Dies ist ein komplexer Prozess und geschieht nicht von heute auf morgen.

Ausserdem müssen Anbieter von Smart Speakern dringend über die Bücher, denn es ist nicht die erste Schwachstelle, die offengelegt worden ist. Und wenn du deine Lücke stopfen und keine Smart-Speaker-, Smart-Home- oder andere Tech-News und -Trends mehr verpassen möchtest, dann folge mir mit einem Klick auf den «Autor folgen»-Button beim Autorenprofil.

Wenn ich nicht gerade haufenweise Süsses futtere, triffst du mich in irgendeiner Turnhalle an: Ich spiele und coache leidenschaftlich gerne Unihockey. An Regentagen schraube ich an meinen selbst zusammengestellten PCs, Robotern oder sonstigem Elektro-Spielzeug, wobei die Musik mein stetiger Begleiter ist. Ohne hüglige Cyclocross-Touren und intensive Langlauf-Sessions könnte ich nur schwer leben.